A definição do pesquisador Ergon Cugler deu o tom de debate ocorrido nesta sexta-feira (5), em São Paulo, durante o 8º Encontro Nacional de Comunicadores e Ativistas Digitais; Ana Mielke e Julie Ricard denunciaram o viés racista e de gênero da Inteligência Artificial

Felipe Bianchi

A regulação das plataformas e da Inteligência Artificial é um dos temas mais urgentes em todo o planeta para barrar o avanço do fascismo e a destruição das democracias. Os pesquisadores Ergon Cugler, Julie Ricard e Ana Mielke aprofundaram o assunto em debate ocorrido nesta sexta-feira (5), em São Paulo, durante o 8º Encontro Nacional de Comunicadores e Ativistas Digitais.

O evento reuniu mais de 150 jornalistas, comunicadores populares, ativistas digitais e estudantes para discutir as pautas mais relevantes na luta pela democratização da comunicação no país.

De acordo com a jornalista Ana Mielke, conhecer minimamente a dimensão técnica do debate em torno das plataformas e da IA é fundamental para incidir politicamente em seus rumos. “Por que as sociedades atuais têm naturalizado que as novas tecnologias de informação são obrigatoriamente, exclusivamente, necessariamente produtos da iniciativa privada?”, questionou a coordenadora do Intervozes.

“Com a imposição do neoliberalismo em nosso países, o Estado deixou de ser provedor de serviços e direitos fundamentais à população para ser mediador entre os consumidores e as empresas privadas que passaram a explorar esse espaço”, explicou, citando o caso da privatização do setor de telefonia durante o governo Fernando Henrique Cardoso (FHC) no Brasil.

A partir dessa lógica, Mielke avalia que há uma ideia dominante de que só o setor privado é capaz de produzir e fornecer plataformas digitais: “Temos de desnaturalizar a suposta hegemonia intelectual das big techs como únicas e exclusivas produtoras de conhecimento e tecnologia”.

“Boa parte do setor da Educação no Brasil é dominado por essas plataformas. O debate público também é dominado por elas. É preciso pensar a IA, as plataformas e as tecnologias para além do lugar do usuário”, pontuou. “Não se trata de uma dicotomia entre combater ou aderir à IA, mas pensar como fazer o uso dessas tecnologias para além da submissão aos mecanismos e plataformas que nos são vendidos pela iniciativa privada”.

O que está em jogo, segundo Mielke, são os nossos dados e, em última instância, a soberania de nossas próprias vidas. “Conglomerados privados de tecnologia dominam a economia do mundo. Serão eles os mediadores da esfera pública? Serão eles os determinadores da nossa democracia?”, provocou.

Sobre a disputa política em curso no Brasil, a jornalista convoca à luta pelo Projeto de Lei 2338, que busca criar parâmetros básicos de regulação das plataformas. “O PL 2338 responde à necessidade de criar regras para o ambiente das IA no Brasil. As big techs incidem de forma agressiva no Congresso brasileiro. O lobby é escancarado”, denunciou.

IA é coisa de robôs?

Pesquisador em Políticas Públicas, Desinformação & Tecnologias, Ergon Cugler alerta que é preciso desmitificar o senso comum de que a Inteligência Artificial diz respeito à figura de um robô. “IA não é um robozinho trabalhando para as pessoas, mas uma tabela. Por trás dela, estão processos de aprendizagem onde parâmetros passam por decisão de quem desenvolveu a tecnologia”, sublinhou.

Quem desenha a tecnologia, afirmou Cugler, é quem define como o “robô” vai funcionar. Não é por acaso que valores com viés racista ou de gênero se reproduzem nessas tecnologias, como as de reconhecimento facial.

“A IA não é inteligente. O que a galera do Vale do Silício tem a ver com o rosto da galera do Brasil? Reconhecimento facial construído sob algoritmos racistas podem prender inocentes por uma questão de soma e subtração que deu errado no algoritmo”, afirmou.

O tema é urgente pois, segundo o pesquisador, as plataformas são cúmplices desses processos. Para cumprir seus objetivos comerciais, elas optam por ampliar a disseminação de desinformação e discurso de ódio do que ajudar a barrar esses conteúdos.

“Não é uma questão de opinião”, pontuou. “Estudo do NetLab mostra que o algoritmo do YouTube tem ajudado a radicalizar brasileiros no debate sobre crise climática. O objetivo da plataforma é te manter o máximo de tempo possível dentro dela, não importa se é um conteúdo violento ou falso. Outro estudo mostra que o TikTok privilegia conteúdos violentos para adolescentes, que têm mais tendência a consumir esse tipo de material”.

No fim, os algoritmos das big techs são como uma Constituição à qual só os donos delas têm acesso. “Se as leis são definidas pelo Vale do Silício, significa que são eles que regem nossa soberania”, argumentou.

Inteligência enviesada?

Um dos principais problemas das IA, segundo Julie Ricard, são os vieses que elas reproduzem. “Redes sociais, plataformas de streamings, sistemas de navegação e mapas, sistemas de recomendação das plataformas, ferramentas de tradução. Tudo é inteligência artificial”, disse.

Consultora da Unesco, da Secretaria de Comunicação Social da Presidência da República (Secom) e diretora da Data-Pop Alliance, Ricard traçou um panorama sobre alguns dos problemas mais visíveis da IA.

Consultora da Unesco, da Secretaria de Comunicação Social da Presidência da República (Secom) e diretora da Data-Pop Alliance, Ricard traçou um panorama sobre alguns dos problemas mais visíveis da IA.

Ela menciona o documentário Coded Bias (2020), dirigido por Shalini Kantayaa, que conta a história da pesquisadora negra Joy Buolamwini no famoso Instituto de Tecnologia de Massachusetts (MIS), nos Estados Unidos.

“A cientista haitiana trabalhou com algoritmos de reconhecimento facial. Ela percebeu que o algoritmo não reconhecia o rosto dela. Dos colegas brancos, funcionava. Ao usar uma máscara branca, o algoritmo enfim funcionou”, relatou. “Ou seja, os algoritmos desse tipo apresentaram uma margem de erro muito elevada com mulheres e pessoas negras”.

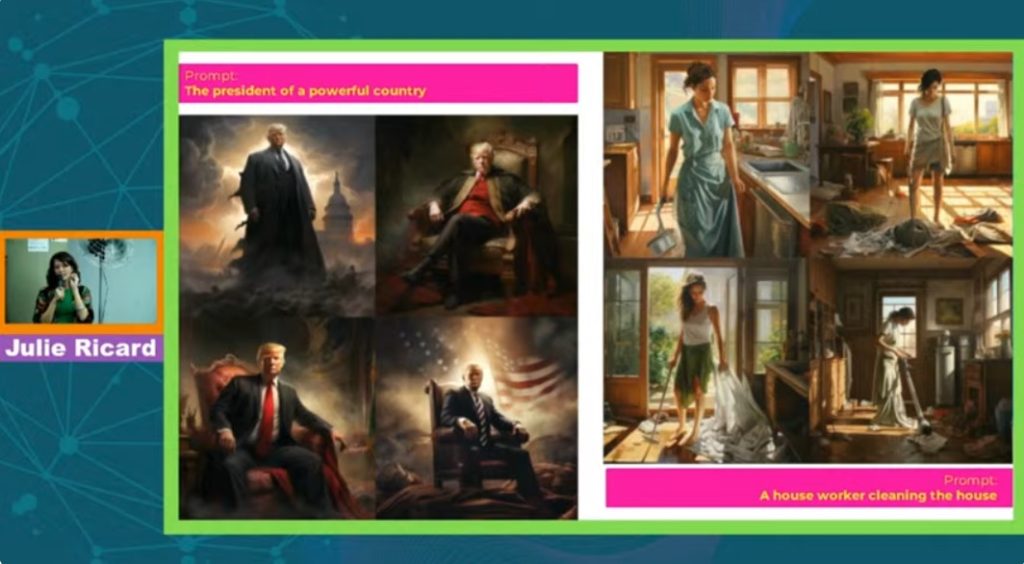

Como experiência, ela sugere acessar alguma IA de geração de imagens. Em seu exemplo, Ricard deu dois comandos: a criação de uma imagem com a definição “representação de uma figura presidencial poderosa” e a de uma “pessoa executando tarefas domésticas” – no caso, uma faxina. O resultado foi este:

O emprego de algoritmos de reconhecimento facial em instituições de segurança pública reproduzem o racismo pelo banco de dados gerado por uma decisão supostamente automatizada.

O viés machista não pára por aí. Ricard instiga a reflexão sobre por que as vozes de representação de dispositivos, como Alexa, Google Now, Siri e Cortana. são quase sempre femininas. “Será que isso não é um problema?”, questionou, mencionando também como essas IA podem turbinar a produção de desinformação com fins políticos e a de sexualização de pessoas.

Sobre o #8BogProg

Jornalistas, ativistas digitais, comunicadores populares, pesquisadores e estudantes se reúnem nos dias 5 e 6 de julho, no auditório do Sindicato dos Jornalistas de São Paulo, para a 8ª edição do Encontro Nacional de Comunicadores e Ativistas Digitais.

A programação traz especialistas para debaterem temas como o fortalecimento da comunicação pública, das mídias alternativas e comunitárias, a relação da juventude com a comunicação, os desafios colocados pela inteligência artificial e a regulação das plataformas.

O evento é organizado pelo Centro de Estudos da Mídia Alternativa Barão de Itararé com o patrocínio do Núcleo de Informação e Coordenação do Ponto BR (NIC.br), através do Comitê Gestor da Internet no Brasil (CGI.br).

Todos os debates têm transmissão ao vivo pelo canal do Barão de Itararé no YouTube e por canais parceiros. Inscreva-se e assista na íntegra!